Peter Steinberger, el creador del agente de IA OpenClaw, se levantó el sábado con un montón de menciones en su cuenta de Twitter. En todas le avisaban de lo mismo: Anthropic anunciaba que las cuentas de Claude Code (Claude Pro/Max) no se podían usar en OpenClaw. La decisión le dejó de todo menos indiferente, y los usuarios de este agente han criticado una decisión que aun siendo razonable es, en cierto modo, una táctica inquietante por cómo y cuándo ha llegado.

Qué ha pasado. OpenClaw es el agente de IA que si quieres toma el control de tu máquina y usa sus apps para hacer por ti todo lo que le pidas. Su funcionamiento es muy potente, sobre todo si lo usas con modelos de calidad como Claude Opus 4.6 o Claude Sonnet 4.6. Muchos usuarios aprovechaban los planes Claude Pro y Claude Max para sacar el máximo partido a OpenClaw, pero Anthropic ha dicho que eso no se puede hacer. Como explican OpenClaw y otros agentes de IA consumen demasiados tokens y esos planes están pensados para ser usados en Claude Code para programar.

Si quieres usar Claude con OpenClaw, paga. En Anthropic no prohíben el uso de sus modelos de IA con OpenClaw, pero dejan claro que si quieres usarlos debes usarlos con su API. Es como si te comprases el abono transporte mensual de 20 euros para viajar sin límite en metro: funciona perfecto cuando vas y vuelves del trabajo o la universidad, pero Anthropic dice que no puedes usar ese abono para utilizarlo en tu empresa de mensajería que realizan cientos de viajes al día. El consumo de tokens en Claude Code es manejable, pero en OpenClaw ese consumo se dispara y en Anthropic quieren que pagues por uso, no que aproveches la "tarifa plana" (con límites) de sus planes Pro/Max.

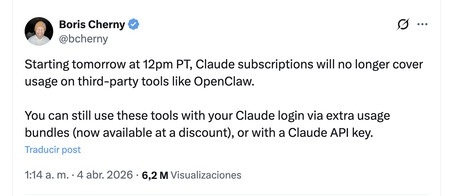

Es comprensible... Muchos usuarios se han echado encima de Anthropic y han criticado esa decisión. Boris Cherny, uno de los máximos responsables de Claude Code, contestaba en X a un usuario que le decía que esa decisión "apestaba":

"Sé que apesta. En esencia, la ingeniería se basa en tomar decisiones difíciles, y una de las cosas que hacemos para atender a muchos clientes es optimizar el funcionamiento de las suscripciones para llegar a la mayor cantidad de personas posible con el mejor modelo.

Los servicios de terceros no están optimizados de esta manera, por lo que nos resulta muy difícil mantenerlo a largo plazo".

Es cierto que el uso masivo de Claude en OpenClaw dispara los costes internos de la infraestructura de Anthropic: no les sale a cuenta que tantas instancias de OpenClaw estén siendo usadas con Claude, al menos no si no se usan con la API. Es algo razonable porque efectivamente esos planes "hacen trampa" al poder usarse con este y otros agentes de IA. Pero...

... el momento es curioso. Esta decisión llega poco después de que Anthropic haya comenzado a "copiar" algunas de las características de OpenClaw en sus productos, algo que también esperábamos. Claude Cowork, Dispatch y Remote Control se han convertido en las formas "oficiales" de poder hacer parte de lo que hace OpenClaw directamente con herramientas de Anthropic, y poco después de sacarlas es cuando comienzan a capar la forma en la que los usuarios pueden usar sus planes mensuales. Para Peter Steinberger, creador de OpenClaw, que la decisión de Anthropic llegue ahora es significativo:

"Es gracioso cómo coinciden los tiempos: primero copian las funciones más populares de nuestra herramienta a su propio producto cerrado, y luego bloquean el acceso al open source".

Anthropic no miente. El argumento técnico que menciona Cherny es real, y lo cierto es que hay un poroblema de capacidad. Los modelos de Claude son caros de ejecutar, la demanda crece más rápido que la infraestructura y los usuarios de agentes de IA como OpenClaw consumen recursos de forma mucho más intensiva que los usuarios convencionales de chat o de Claude Code. Esto no es sostenible, pero también es cierto que esta decisión llega tres semanas después de que Steinberger "vendiera" OpenClaw a OpenAI, la némesis de Anthropic.

Anthropic en modo Nintendo. Estamos ante el clásico patrón del jardín amurallado: observas qué funciona en otra plataforma o producto rival, lo absorbes y luego cierras la puerta. Nintendo lo ha hecho durante décadas con los desarrolladores de su plataforma y Apple lo ha perfeccionado con la App Store. La diferencia es que Nintendo y Apple tenían ese jardín amurallado desde el principio, y Anthropic lo está construyendo ahora.

Aunque no sea exactamente lo mismo. Hay que señalar que Nintendo está protegiendo un ecosistema con décadas de IPs (Propiedades Intelectuales) irremplazables: Mario, Zelda, o Metroid. Es normal que haya un coste de acceso. Anthropic está haciendo eso ahora mismo con Claude como producto estrella, pero obviamente no tiene algo comparable (de momento) a las IPs que tiene Nintendo. Hay aquí otra comparación inquietante: Apple o Nintendo cobran por entrar al ecosistema pero no deja el contador corriendo. Anthropic sí: tiene un jardín cada vez más cerrado, pero además obliga a usar la API para usar OpenClaw, con un modelo de pago por uso que es razonable debido a la demanda de Claude.

Pero es que el resto sí "dejan". Lo que ha hecho Anthropic choca con lo que están haciendo otras empresas de IA, sobre todo cuando hablamos de startups chinas. Los creadores de Kimi, Minimax, GLM o del reciente Xiaomi MiMo no tienen estas políticas: puedes contratar sus planes mensuales, muy baratos, y aprovechar sus modelos para OpenClaw sin problemas y sin (apenas) límites. Es cierto que estos modelos no son tan capaces como Claude, pero aun así llama la atención la forma de actuar de unos y otros.

Ver 5 comentarios