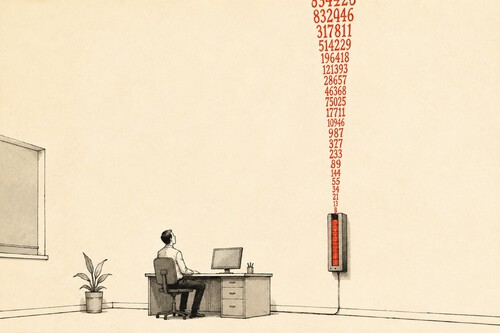

El tokenmaxxing tiene ahora su caso más documentado. Algunos empleados de Amazon llevan semanas usando MeshClaw, una herramienta interna de agentes de IA, para automatizar tareas innecesarias y así inflar su consumo de tokens en los marcadores internos que la empresa ha puesto en marcha.

No es la primera vez que ocurre algo así en Silicon Valley:

- Meta tuvo su propia tabla de clasificación de tokens, con un ganador que se llevaba el título de Token Legend.

- Y en Microsoft se han documentado patrones similares.

Pero el caso de Amazon añade un detalle que lo hace más llamativo: la herramienta que se usa para hacer trampa es la misma que Amazon ha desplegado oficialmente para que sus ingenieros trabajen mejor.

Por qué es importante. Amazon exige que más del 80% de sus desarrolladores usen herramientas de IA cada semana y mide el cumplimiento mediante marcadores de consumo de LLMs. La empresa ha dicho que esas estadísticas no se usarán en evaluaciones de rendimiento.

Varios empleados han respondido con variaciones de la misma frase: los managers sí lo están mirando. "Cuando rastrean el uso, se crean incentivos perversos y hay gente muy competitiva con esto", le dijo uno de ellos al Financial Times.

Sí, pero. Hay una lectura más generosa. Forzar a una organización grande a entrar en contacto con herramientas nuevas tiene cierta lógica: si se obliga a suficiente gente a usarlas, alguien acaba encontrando un uso realmente útil.

El problema es que eso solo funciona si hay exploración real. Un empleado que delega en un agente la tarea de resumir correos que nadie leerá no está aprendiendo nada, solo está hinchando sus métricas.

La gran pregunta. Amazon ha comprometido 200.000 millones en infraestructura de IA cuya demanda, en teoría, se va absorbiendo a medida que se despliega. Si una parte de ese consumo interno es tokenmaxxing puro, las cifras que justifican esos pedidos son menos fiables de lo que parecen.

La distinción entre adopción real y consumo inflado importa porque la primera genera demanda duradera mientras que la segunda desaparece en cuanto cambian los incentivos. Amazon ya ha restringido el acceso público a las estadísticas de uso por equipos. Cuando el marcador deja de ser visible, el comportamiento que incentivaba también cambia.

Profundiza. La ley de Goodhart lleva cincuenta años explicando esto: cuando una medida se convierte en objetivo, deja de ser una buena medida. Amazon no ha construido un sistema para saber si sus ingenieros usan bien la IA. Ha construido un marcador, y los marcadores se juegan.

En Xataka | Si la pregunta es si usar ChatGPT o Claude en inglés es más eficiente y ahorra tokens, la respuesta es: yes

Imagen destacada | Xataka

Ver 0 comentarios