La Inteligencia Artificial está transformando e incluso revolucionando las dinámicas de funcionamiento de áreas de actividad en todo tipo de sectores. La programación es uno de ellos, pasando por la automatización de procesos de negocio e industriales, sin olvidar el diseño, entrenamiento u optimización de los grandes modelos de lenguaje LLMs en los que se sustenta en gran medida y en este momento, la IA generativa.

La Inteligencia Artificial Generativa, además, es una tecnología en pleno proceso de investigación y desarrollo. Las noticias que describen los hitos alcanzados en su aplicación práctica en la vida real, conviven con las noticias que versan sobre los avances llevados a cabo en la tecnología de la IA propiamente dicha.

Hablamos de modelos más eficientes, más precisos, adaptados a todo tipo de dispositivos, compatibles con diferentes tipos de datos, capaces de razonar con mayor profundidad o con agencia para llevar a cabo tareas de forma autónoma. Incluso de modelos que no solo entienden el lenguaje, sino también “el mundo” en los llamados “world models” en los que se sustenta la IA aplicada a la robótica.

En este contexto, la soberanía del dato y la eficiencia operativa ya no son un lujo, sino una necesidad estratégica que la "pequeña bestia" HP ZGX Nano AI busca resolver de forma definitiva.

IA local: cuando el control, la eficiencia de costes y la soberanía de los datos importan

Las tecnologías cloud son esenciales para desplegar a escala tecnologías como Internet primero, el software como servicio después o la IA generativa ahora. Pero, no siempre son convenientes. Especialmente, cuando se trata de trabajar con la IA desde la perspectiva de la investigación y el desarrollo.

En los departamentos de I + D es habitual trabajar con datos o código que no es conveniente que estén expuestos más allá de los confines de la red local o corporativa de las empresas

En los departamentos de I + D es habitual trabajar con datos o código que no es conveniente que estén expuestos más allá de los confines de la red local o corporativa de las empresas, organizaciones o entidades que estén involucradas en el desarrollo, optimización o inferenciación con modelos de IA.

Tampoco es desdeñable el coste asociado que tiene el uso de la IA alojada en la nube. Todo ello “invita” a las empresas y profesionales que trabajan con inteligencia artificial a que desplieguen sus propias soluciones de trabajo con IA en local, con equipos capaces de procesar y calcular tokens con la agilidad suficiente como para que no sean un cuello de botella.

Potencia de cálculo más memoria, el santo grial para procesamiento de IA

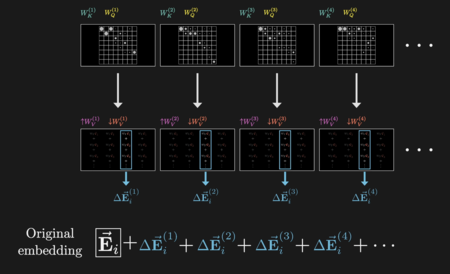

La IA generativa, los LLMs y los modelos “del mundo” que se empiezan a construir más allá de los modelos de lenguaje, se sustentan sobre cálculos matemáticos que involucran ingentes cantidades de números, que conforman matrices y vectores con decenas de miles de dimensiones que se operan sobre matrices, también con decenas de miles de dimensiones.

https://www.3blue1brown.com/lessons/attention#title

https://www.3blue1brown.com/lessons/attention#title

Esos cálculos matemáticos se operan a escala, con diferentes precisiones de coma flotante, tanto para tareas de entrenamiento, optimización (fine tuning) o cuantización, como para inferencia o vectorización en procedimientos como la generación aumentada por recuperación (RAG o retrieval augmented generation).

No se trata de que sustituyan a un centro de datos de 100 MW o 300 MW, pero sí de poner en manos de los profesionales una herramienta a la altura de sus necesidades

Los dispositivos que usemos para procesamiento de IA on premise, tendrán que ofrecer un rendimiento excepcional para que sean útiles a la escala para la que están pensados. No se trata de que sustituyan a un centro de datos de 100 MW o 300 MW, por supuesto, pero sí de poner en manos de los profesionales una herramienta a la altura de sus necesidades.

Hablamos de campos sumamente exigentes como la secuenciación de RNA, la ejecución de modelos de frontera como el nuevo Gemma 4 31B IT, la optimización de modelos hasta 70.000 millones de parámetros (70B) con Pytorch o NeMo, la aceleración de algoritmos de machine learning usando librerías CUDA-X Data Science, o el despliegue de IA agéntica a escala a través del stack de NemoClaw y modelos como Nemotron-3-Super 120B junto con Telegram como interfaz, entre otros muchos escenarios de uso.

La solución pasa por HP ZGX Nano AI: 1000 TOPS y 128 GB de memoria unificada

El “tamaño” de los modelos de IA no solo se mide por su número de parámetros; la verdadera barrera reside en la capacidad de procesar esos datos sin latencia. Aquí es donde la HP ZGX Nano AI marca la diferencia al integrar el Superchip NVIDIA® GB10 Grace Blackwell. A diferencia de las arquitecturas tradicionales, este superchip combina una CPU Grace de 20 núcleos ARM con la potencia de la arquitectura Blackwell, permitiendo alcanzar un hito en este formato: 1000 TOPS de rendimiento total.

Se pueden combinar dos ZGX nano G1 para duplicar la potencia de cálculo

Se pueden combinar dos ZGX nano G1 para duplicar la potencia de cálculo

A pesar de las apariencias, esta estación de trabajo es más capaz para el procesamiento de inteligencia artificial que las unidades “clásicas” con GPUs dedicadas. La razón estriba en sus 128 GB de memoria LPDDR5X unificada, que permite que tanto la CPU como la GPU accedan al mismo pool de datos a una velocidad de 273 GB/s. Esta arquitectura elimina los cuellos de botella habituales en la transferencia de datos, logrando que sus 240 W de consumo superen en tareas específicas de IA a configuraciones que doblan su gasto energético.

A pesar de las apariencias, esta estación de trabajo es más capaz para el procesamiento de inteligencia artificial que las unidades “clásicas” con GPUs dedicadas

Pero el hardware es solo la mitad de la ecuación. Para domar esta potencia, la HP ZGX Nano AI llega preparada para la inferencia con el sistema operativo NVIDIA DGX, un entorno de grado empresarial diseñado específicamente para desarrollo de IA y tareas de inferencia evaluativa. Esta máquina no solo ejecuta software: integra una pila de software con IA NVIDIA optimizada, que incluye todas las librerías y frameworks necesarios para que los desarrolladores pasen del desempaquetado al entrenamiento o la inferencia en cuestión de minutos.

Al combinar el músculo del Superchip GB10 con la robustez del ecosistema NVIDIA DGX, HP ofrece una solución que permite manejar con fluidez LLMs de hasta 200.000 millones de parámetros (200B) en inferencia y hasta 70.000 millones (70B) en tareas de fine-tuning, todo bajo un entorno de software profesional y estandarizado.

Una estación de trabajo para IA, casi en la palma de la mano

La HP ZGX Nano AI tiene un peso de poco más de 1,2 Kg y ocupa un volumen de poco más de 1,1 litros. Incluso si conectamos dos HP ZGX Nano AI en serie, a través del puerto de comunicaciones ópticas QSFP disponible a tal efecto y la tecnología NVIDIA ConnectX, el peso y el tamaño de esta configuración siguen siendo excepcionalmente comedidas.

Podemos destacar el despliegue de soluciones agénticas completas, sin necesidad de APIs de terceros para mover LLMs de hasta 200B parámetros

La logística asociada a la instalación y puesta a punto de esta solución de alto rendimiento de IA está simplificada al máximo. Se puede mover entre diferentes ubicaciones sin dificultad y puede usarse con soluciones existentes Windows, Mac o Linux a través de la conectividad de red. Y con la ventaja de que los datos empresariales y la propiedad intelectual de los proyectos desarrollados internamente están fuera del alcance de Internet.

A pesar de sus reducidas dimensiones, la HP ZGX Nano AI es capaz de hacerse cargo con fluidez y solvencia de las operaciones matemáticas involucradas en el despliegue de soluciones de IA generativa y agéntica que dependan de LLMs de hasta 200.000 millones de parámetros (200B) en inferencia y hasta 70.000 millones de parámetros (70B) en tareas como fine tuning.

La HP ZGX Nano AI G1 se sustenta sobre la tecnologia NVIDIA DGX Spark

La HP ZGX Nano AI G1 se sustenta sobre la tecnologia NVIDIA DGX Spark

Si vamos a casos concretos, podemos destacar el despliegue de soluciones agénticas completas, sin necesidad de recurrir a APIs de terceros para mover LLMs de hasta 200B parámetros. Con la plataforma NemoClaw, el modelo Nemotron-3-Super 120B y una interfaz local, las empresas pueden ejecutar flujos de trabajo agénticos completos en el propio dispositivo, lo que ayuda a minimizar los costes por token asociados a las API de modelos externos

Es una ventaja estratégica en la ciencia de datos, la secuenciación genética en biotecnología, el desarrollo de tecnologías de IA innovadoras o en la robótica

En otros entornos, la HP ZGX Nano AI también se convierte en una ventaja estratégica para empresas que trabajen en campos como la ciencia de datos, la secuenciación genética en biotecnología, el desarrollo de tecnologías de IA innovadoras en el diseño de modelos de lenguaje más eficientes o de modelos del mundo para campos tan innovadores como la robótica.

El entrenamiento de robots, actualmente, pasa por la predicción visual de eventos en tiempo real, ante la ausencia de modelos del mundo que trabajen con magnitudes e interacciones físicas. Estaciones de trabajo especializadas en IA como la ZGX Nano AI, permiten a las empresas involucradas en el desarrollo de soluciones robóticas, avanzar en el diseño de modelos más precisos, fiables y eficientes.

Al disponer de aceleración de IA localmente (en el edge), la latencia disminuye drásticamente en tareas de IA en tiempo real

Al disponer de aceleración de IA localmente (en el edge), la latencia disminuye drásticamente para tareas de IA en tiempo real, lo cual es una ventaja competitiva excepcional para los investigadores y desarrolladores.

La seguridad es otra variable importante, al no tener que exponer obligatoriamente los datos empresariales a la nube, ni tener que procesarlos en servidores fuera del ámbito de la propia red local de las organizaciones.

HP lo pone aún más fácil con este kit de herramientas

HP, además, incluye el kit de herramientas HP ZGX, que simplifica el proceso de despliegue y puesta a punto del software necesario para empezar a trabajar con IA a través de herramientas de código abierto como MLflow y Ollama. El kit de herramientas optimiza los flujos de trabajo de IA al combinar una potente computación local con herramientas de código abierto, un descubrimiento integrado y una fácil exportación, lo que permite a los equipos reducir la fricción, aumentar la productividad y escalar los resultados en cualquier lugar.

La compatibilidad con la pila de software NVIDIA DGX Spark es total, por supuesto, extendiendo el ámbito de uso de las estaciones de trabajo HP ZGX Nano AI gracias al acceso a herramientas, librerías y flujos de trabajo relacionados con la IA y el Machine Learning.

En un tiempo en el que las condiciones de uso de la IA generativa en la nube cambian prácticamente de un día para otro, especialmente en lo que concierne al coste de los tokens o al ámbito de uso de las licencias, disponer de soluciones on premise junto con modelos abiertos, paulatinamente más capaces y fiables, así como fine-tuneables, es una ventaja estratégica de primer orden para empresas, organizaciones y profesionales involucrados en la construcción de la inteligencia artificial de los próximos años.

Se trata de una solución escalable y amparada por un ecosistema de desarrollo de código abierto que evoluciona y crece como las soluciones propietarias

Además, se trata de una solución escalable y amparada por un ecosistema de desarrollo de código abierto que evoluciona y crece a un ritmo tan acelerado como el de las soluciones propietarias y cerradas, que abre las puertas a la innovación y desarrollo de soluciones de IA a empresas de todos los tamaños en muy diferentes campos de actividad.

Especificaciones de la HP ZGX Nano AI G1:

|

Apartado |

Especificación |

|---|---|

|

Modelo |

HP ZGX Nano G1n AI Station / Estación de IA HP ZGX Nano G1n |

|

Formato |

Mini PC / estación de trabajo compacta |

|

Sistema operativo |

NVIDIA DGX OS |

|

Familia de procesador |

NVIDIA Grace Blackwell |

|

Procesador |

NVIDIA GB10 Grace Blackwell Superchip |

|

CPU |

20 núcleos Arm: 10 Cortex-X925 + 10 Cortex-A725 |

|

Gráficos |

GPU basada en arquitectura NVIDIA Blackwell |

|

Memoria |

128 GB LPDDR5x-8533 unificada, integrada en placa |

|

Almacenamiento |

SSD M.2 NVMe con opciones de 1 TB, 2 TB o 4 TB según configuración; HP cita unidades PCIe y en varias configuraciones aparecen SSD autocifrados SED. (hp.com) |

|

Red cableada |

1 x RJ-45 de 10 Gbps |

|

Red inalámbrica |

Wi-Fi 7 (MediaTek MT7925, 2x2) |

|

Bluetooth |

Bluetooth 5.4 |

|

Puertos USB |

3 x USB Type-C con tasa de señalización de 20 Gbps |

|

Vídeo |

1 x HDMI 2.1a |

|

Conectividad de alta velocidad |

2 x QSFP a 200 Gbps |

|

Conector de alimentación |

1 x USB Type-C para alimentación |

|

Audio |

Salida de audio por HDMI |

|

Dimensiones |

15 x 15 x 5,1 cm ; 15 x 15 x 5,45 cm con pies |

|

Peso |

Desde 1,25 kg, según configuración |

|

Color |

Negro |

|

Capacidad orientativa en IA |

HP indica trabajo local en inferencia con modelos de hasta 200.000 millones de parámetros; con dos unidades conectadas, hasta 405.000 millones. (hp.com) |

Ver 0 comentarios